モデルベースシステムエンジニアリング(MBSE)は、複雑なシステムアーキテクチャを定義するためにSysMLに大きく依存している。システムの複雑性が増すにつれて、それらを記述するためのモデルもますます複雑化する。従来の検証手法は主に人的レビューと静的ルールチェックに依存しており、現代のエンジニアリングプロジェクトの動的な性質に対応しきれないことが多く、モデルの整合性が設計意図に追いつかないというボトルネックを生じている。

人工知能(AI)は、これらの課題に対処する道筋を提供する。SysMLワークフローにAI支援検証を統合することで、チームは不整合の自動検出、要件のトレーサビリティの確保、パラメトリック制約のより正確な検証を実現できる。この変化は人間のエンジニアを置き換えるものではなく、彼らの能力を補強し、反復的なエラーチェックから解放して、高レベルなアーキテクチャ設計に集中できるようにする。以下のガイドでは、これらの技術を既存のエンジニアリングプロセスに実践的に統合する方法を検討する。

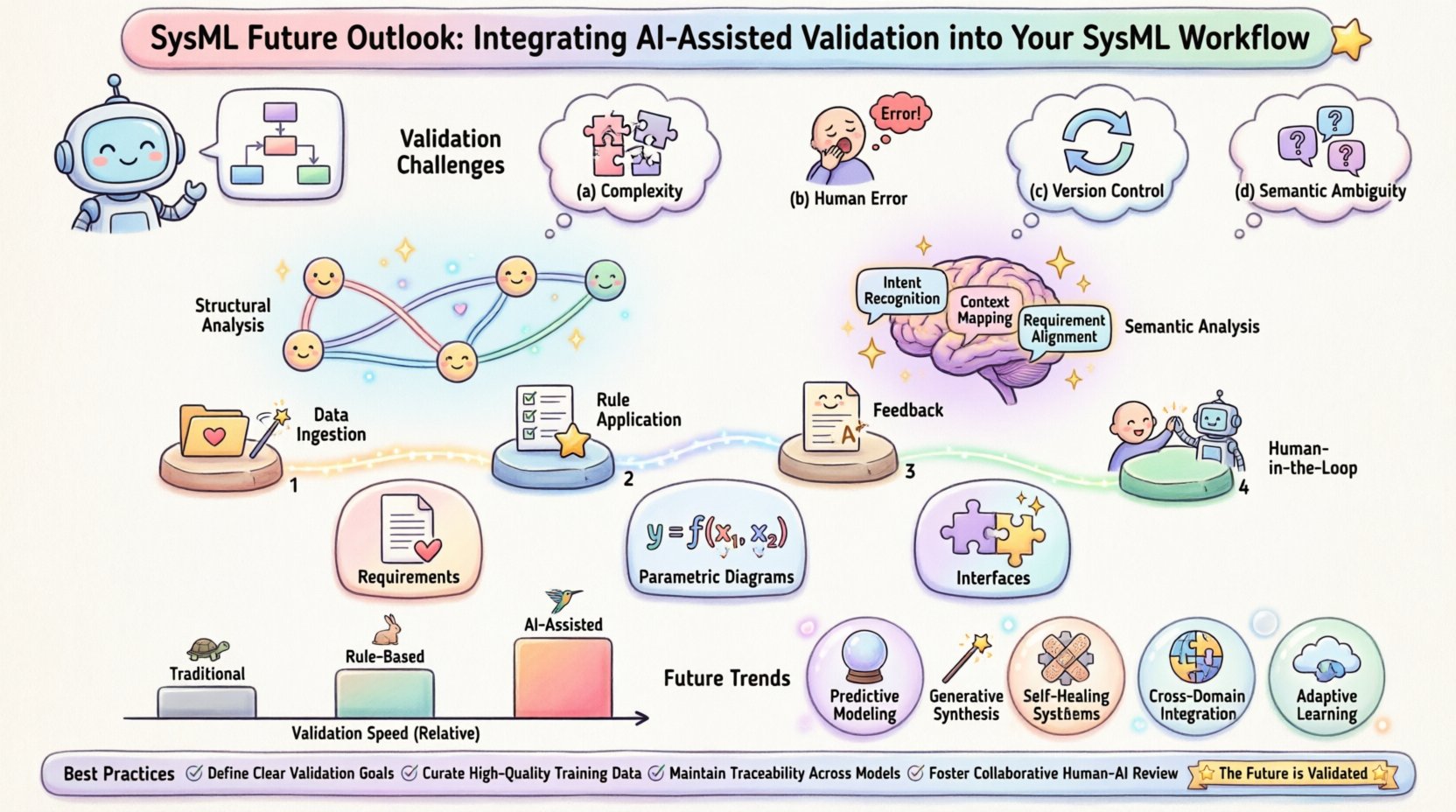

現代のMBSEにおける検証の課題 🛠️

SysMLモデルはシステム設計の唯一の真実の源となる。しかし、大規模な組織全体でこれらのモデルの整合性を維持することは困難である。検証のギャップを生じさせる要因がいくつかある:

- スケールと複雑性:大規模なシステムは数千ものブロック、関係性、要件を含む。すべてのリンクを手動で検証するのは時間的に不可能である。

- 人的ミス:エンジニアは、モデル作成中に偶然に循環参照を作成したり、トレーサビリティリンクを漏らしたり、矛盾する制約を定義してしまうことがある。

- バージョン管理:モデルが進化するにつれて、システムの一部での変更が他の部分の仮定を破壊しないことを保証することは、大きな物流的課題である。

- 意味の曖昧さ:文章による要件には、支援なしでは形式的なモデル構造にマッピングすることが難しい自然言語のニュアンスが含まれることが多い。

自動化された支援がなければ、これらの問題は蓄積される。ブロック定義における小さな不整合が、システム統合段階で重大な失敗を引き起こすことがある。AI統合の目的は、開発ライフサイクルの初期段階でこれらの問題を早期に発見できる継続的なフィードバックループを構築することである。

AI支援検証の理解 🧠

AI支援検証は、機械学習および自然言語処理技術を用いてSysMLモデルを分析することを含む。この技術は主に2つのレベルで動作する:構造的分析と意味的分析。

構造的分析

SysMLモデルは、ノード(ブロック、要件、インターフェース)とエッジ(関係性)から構成されるグラフである。構造的AIはグラフニューラルネットワークを用いてモデルのトポロジーを分析する。以下を特定できる:

- 適切なシミュレーションを妨げる循環依存関係。

- メインシステムに接続されていない孤立したコンポーネント。

- 親ブロックと子ブロックの間の欠落した関係性。

- 定義されたモデリング標準またはテンプレートの違反。

意味的分析

要件はしばしば自然言語で記述される。意味的AIは自然言語処理(NLP)を用いてテキストの意味を理解する。これによりシステムは以下を実現できる:

- 文章による要件を特定のモデル要素にマッチングする。

- 矛盾する要件を検出する(例:一つの要件が高速を要求し、もう一つがトレードオフの説明なしに低消費電力を要求する)。

- コード作成前に明確化が必要な曖昧な言語表現を特定する。

これらのアプローチを組み合わせることで、システム設計の「形」と「意味」の両方を検証する強力な検証エンジンが構築される。

AIをあなたのSysMLワークフローに統合する 🔗

AI検証の導入には、エンジニアリングチームがデータを管理する方法の変化が必要となる。単なるソフトウェアの追加ではなく、プロセスの変更である。統合は4つの主要なフェーズに分けることができる。

1. データの取り込みと正規化

AIがモデルを処理する前に、データは標準化された形式でアクセス可能でなければなりません。SysMLモデルはしばしばXMI(XMLメタデータ交換)ファイルに格納されます。統合プロセスは以下の点を確実にしなければなりません:

- モデルファイルが正しく抽出され、解析されること。

- メタデータがモデル構造と共に保持されること。

- 自然言語による要件が、NLPモデルが読み取れる形式でエクスポートされること。

2. 自動ルール適用

この段階では、正規化されたデータに対してAIアルゴリズムを実行します。手動レビューを待つ代わりに、システムは継続的にチェックを実行します。主なチェック項目は以下の通りです:

- 構文的妥当性:モデルはSysMLの文法に準拠していますか?

- トレーサビリティ:すべての要件が設計要素にリンクされていますか?

- 制約の満足度:パラメトリック方程式は有効な値に解決されますか?

3. フィードバックとレポート作成

AIエンジンは、発見した内容をエンジニアにフィードバックしなければなりません。これは単なる合格/不合格の指標ではありません。レポートは以下の点を強調すべきです:

- エラーを引き起こしている特定の要素。

- 違反の性質。

- 類似した解決済みの問題に基づいた是正ステップの提案。

4. ヒューマンインザループによる検証

AIは判断者ではなくツールです。エンジニアはAIが生成したフラグを確認し、正当性を検証する必要があります。誤検出は発生するため、文脈を解釈するための人的判断が不可欠です。このステップにより、AIは修正から学び、時間とともに改善されることが保証されます。

AI介入の重要な領域 🎯

SysMLモデルの異なる部分は、それぞれ異なるAI技術の恩恵を受けることができます。技術をどこに適用すべきかを理解することで、最大の投資効果が得られます。

要件管理

要件はMBSEの基盤です。AIは要件セットを分析し、以下の点を確認できます:

- 一意性:2つの要件が同じ内容を述べていないこと。

- 完全性:すべての必要なシステム機能が記述されていること。

- 一貫性:要件同士が互いに矛盾していないこと。

- 検証可能性:要件が検証可能な形で表現されていること。

パラメトリック図

パラメトリック図はシステムの物理的および数学的制約を定義します。AIは以下の点を検証できます:

- 方程式の可解性:システムが過剰に制約されずに方程式が解けることを保証する。

- 変数の単位:入力と出力の単位が一致しているかを確認する(例:メートル vs. 秒)

- 境界条件:システムが動作範囲の端で正しく動作することを検証する。

インターフェース定義

インターフェースはコンポーネント間の通信方法を定義する。AIは次をチェックできる:

- ポートの一致:入力ポートと出力ポートの型とデータフローが一致していることを確認する。

- 信号整合性:信号定義の完全性を分析する。

- プロトコル準拠:定義されたプロトコルが業界標準と一致しているかを確認する。

実装上の障壁の克服 ⚠️

エンジニアリングワークフローにAIを導入することは、課題を伴わないわけではない。成功するためには、技術的・文化的な障壁を乗り越える必要がある。

データ品質とプライバシー

AIモデルは高品質な訓練データを必要とする。過去のモデルに誤りが多ければ、AIもその誤りを受け入れるよう学習してしまう。さらに、エンジニアリングデータはしばしば機密性が高い。チームは次を確実にすべきである:

- 機密データに対してはローカル処理を使用し、漏洩を防ぐ。

- クラウドベースのモデルを使用する場合は、データを匿名化する。

- データのインジェスト前に、データクリーニングプロセスを確立する。

解釈可能性

エンジニアはAIを信頼する必要がある。AIが要件を無効とマークした場合、エンジニアはその理由を理解できる必要がある。ブラックボックスモデルは、安全が重要な産業では導入が難しい。フラグの背後にある論理を説明できる透明なモデルが好まれる。

既存ツールとの統合

大多数の組織では既存のワークフローが確立されている。AI検証レイヤーは現在のシステムとシームレスに統合されなければならない。つまり、次を意味する:

- XMIなどの標準ファイル形式をサポートする。

- カスタムスクリプト用のAPIを提供する。

- 継続的インテグレーションパイプライン内で動作する。

モデル検証の未来のトレンド 🔮

技術が進歩するにつれ、AI支援検証の能力は拡大する。今後の展望として、いくつかのトレンドが浮上している。

- 予測検証:現在の状態を確認するのではなく、AIは設計トレンドに基づいて将来の失敗を予測する。現在は良いように見える設計選択でも、後で保守問題を引き起こす可能性があるため、その点を警告するかもしれない。

- 生成設計:AIはモデルの検証だけでなく、改善策の提案も行う。要件をより効率的に満たす代替的なブロック構造を提案できるかもしれない。

- 自己修復モデル:高度なシナリオでは、システムが人間の承認後に、欠落しているトレーサビリティリンクの追加など、小さな不整合を自動的に修正するかもしれない。

- クロスドメイン分析:AIは、CADファイルやシミュレーションログなどの他のデータソースとSysMLモデルを接続し、システムの健全性について包括的な視点を提供します。

検証手法の比較

以下の表は、従来の検証手法とAI支援アプローチを比較し、範囲と効率の違いを強調しています。

| 機能 | 従来の手動レビュー | ルールベースの自動化 | AI支援検証 |

|---|---|---|---|

| スピード | 遅い | 速い | 非常に速い |

| 範囲 | 人的能力に制限される | 固定ルールのみ | 包括的(構造+意味) |

| 偽陽性 | 低い | 高い(厳格なルール) | 中程度(調整が必要) |

| 文脈認識 | 高い | なし | 高い(NLPを介して) |

| 適応性 | 高い | 低い | 中程度(学習モデル) |

導入のためのベストプラクティス 📋

運用に影響を与えることなくAI検証を成功裏に統合するため、以下の推奨事項に従ってください。

- 小さなステップから始めましょう:特定のサブシステムまたは1つの図形式から始めましょう。企業全体に拡大する前に、その価値を実証してください。

- 指標を定義しましょう:成功を測るための明確な主要業績評価指標(KPI)を設定しましょう。たとえば、欠陥の漏れの削減やレビュー周期あたりに節約できる時間などです。

- 人間の監視を維持しましょう:重要な安全確認を完全に自動化してはいけません。AIの結果を検証するために、常にエンジニアが関与するようにしましょう。

- ルールを文書化しましょう:AIが何をチェックしているか、そしてどのように意思決定しているかを明確な記録に残しましょう。これはコンプライアンスおよび監査にとって不可欠です。

- チームの研修を実施しましょう:エンジニアがAIレポートの解釈方法を理解していることを確認しましょう。研修により摩擦が軽減され、導入率が向上します。

結論

AI支援検証をSysMLワークフローに統合することは、システム工学において大きな前進を意味します。人間のチームだけでは不可能なほど、モデルをより高速かつ包括的に分析できるツールを提供することで、現代のシステムの複雑性の増大に対応します。構造的整合性と意味的整合性に注力することで、組織は誤りを削減し、トレーサビリティを向上させ、納品を加速できます。

この移行には、慎重な計画、データ品質への投資、継続的な改善へのコミットメントが必要です。しかし、システムの信頼性とエンジニアリング効率における長期的な利点は、その努力を正当化します。AIの能力が進化するにつれ、それはモデルベースシステムエンジニアリングのツールキットにおいて不可欠な存在となるでしょう。

これらのツールを受け入れるエンジニアは、次世代のシステム開発の要求に、より適切に対応できるようになります。MBSEの未来とは、モデルを作成することだけではなく、そのモデルが正確で一貫性があり、実装可能であることを保証することにあります。